在當今數字時代,人工智能技術的快速發展不僅改變了我們的生活方式,還在創作領域嶄露頭角。其中,AI文本生成技術的迅猛發展引起了廣泛關注。本文將深入探討AI文本生成的方法、工具以及一些關鍵技巧,幫助讀者更好地了解并利用這一前沿技術。

1. AI文本生成的方法

AI文本生成的方法多種多樣,涉及到不同的模型和算法。以下是一些常見的AI文本生成方法:

遞歸神經網絡(RNN)

遞歸神經網絡是一種常見的序列模型,具有循環連接的結構,使其能夠處理和記憶序列數據。在文本生成中,RNN可以通過學習上下文之間的關系來生成連貫的文本。然而,RNN在處理長期依賴關系時存在梯度消失和梯度爆炸的問題,限制了其在長文本生成中的表現。

長短時記憶網絡(LSTM)

為了解決RNN的長期依賴問題,長短時記憶網絡應運而生。LSTM引入了門控機制,可以更好地捕捉文本中的長期依賴關系。這使得LSTM在生成長文本時表現更為優越。

注意力機制(Attention)

注意力機制使模型能夠在生成文本時聚焦于輸入序列中的特定部分,從而提高了模型對上下文的理解。Transformer模型的成功運用了注意力機制,為大規模文本生成任務帶來了革命性的變化。

預訓練模型

近年來,預訓練模型如GPT(Generative Pre-trained Transformer)系列在文本生成領域取得了顯著的成就。這些模型通過在大規模語料庫上進行預訓練,學習到了龐大的語言知識庫,再通過微調來適應特定任務。GPT-3等巨大模型在生成文本上表現出驚人的創造力和語境理解能力。

2. AI文本生成的工具

了解不同的AI文本生成工具對于選擇適合自己需求的工具至關重要。以下是一些知名的AI文本生成工具:

OpenAI的GPT系列

OpenAI的GPT系列是當前最為知名的預訓練模型之一。GPT-3擁有1750億個參數,可以用于各種自然語言處理任務,包括文本生成。用戶可以通過OpenAI的API接口使用GPT-3,實現自定義文本生成的應用。

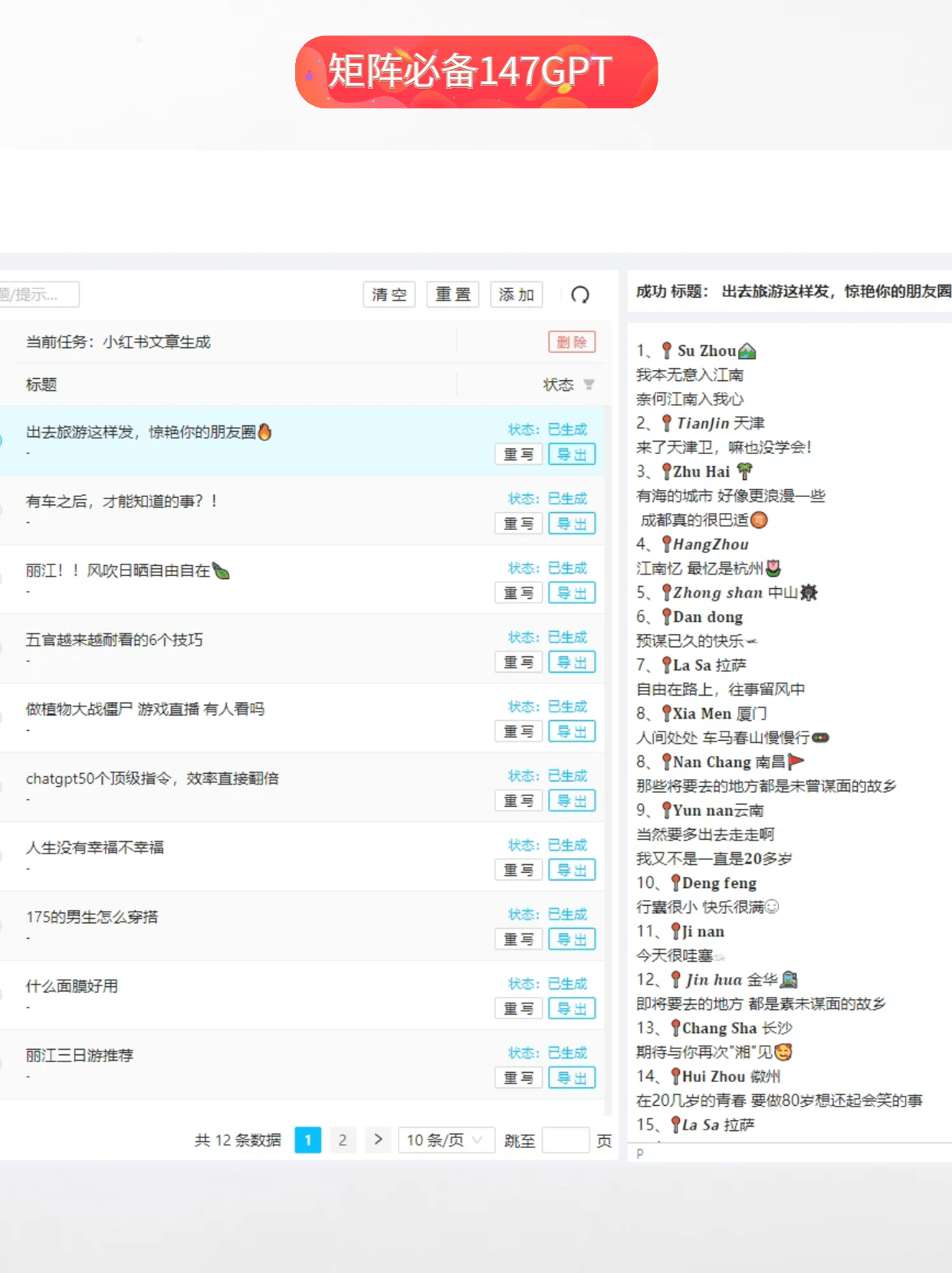

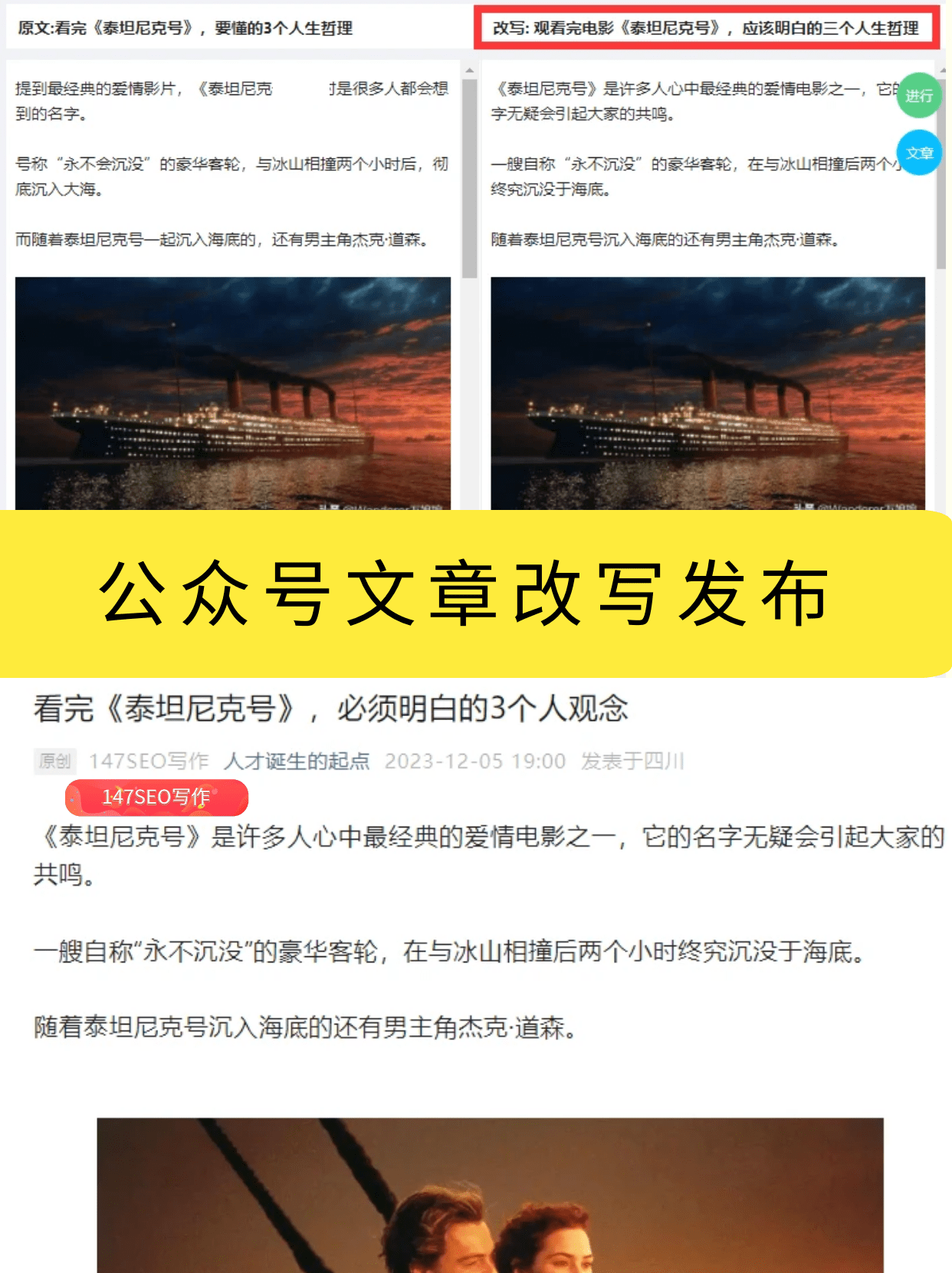

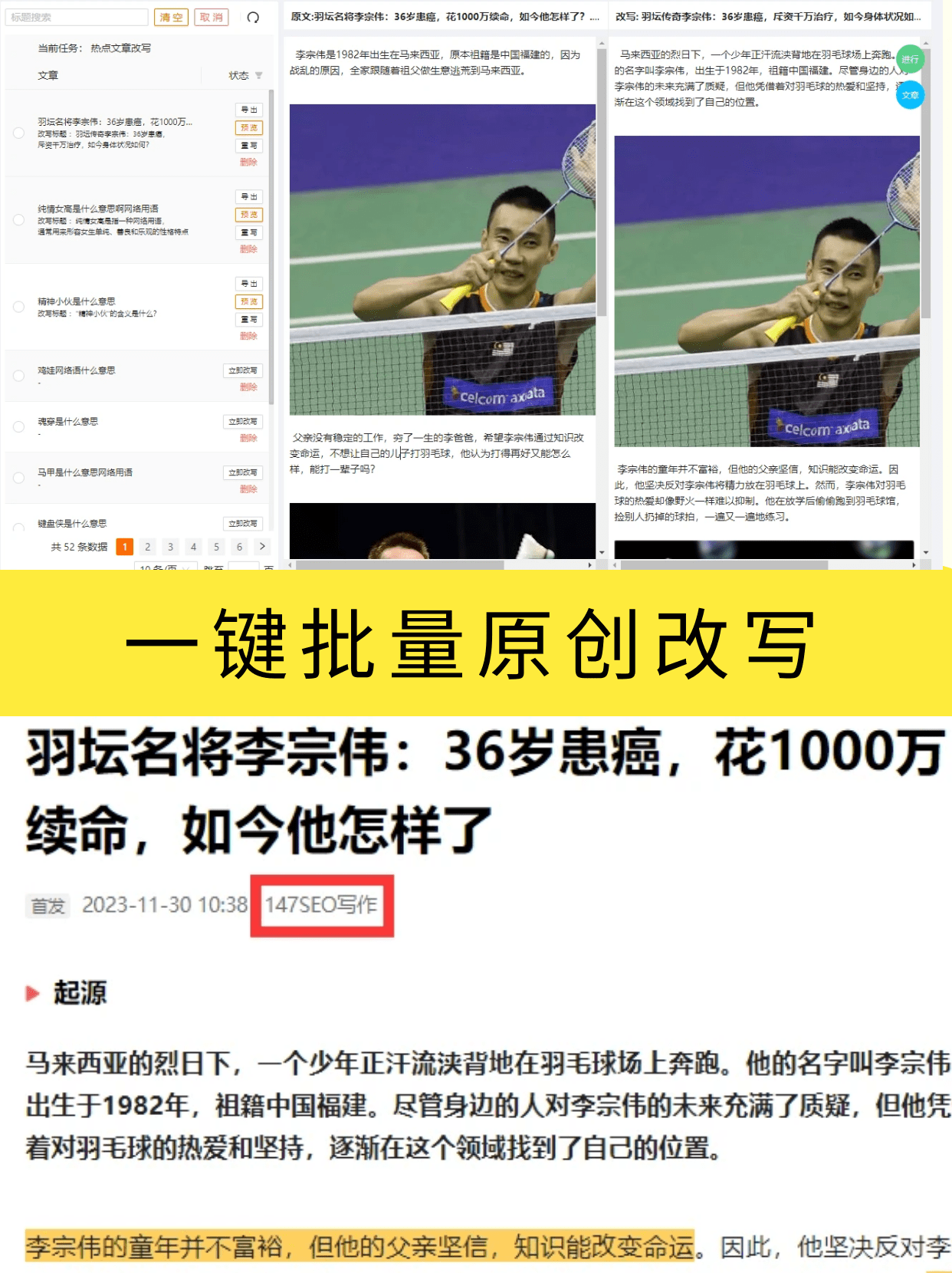

147原創助手

147原創助手是一款中文文本生成工具。它基于深度學習技術,可以生成高質量、流暢的中文文本。有道智云文本生成支持多種應用場景,包括寫作助手、內容創作等。

百度文心一言

百度文心一言是百度旗下的工具

微軟的Azure文本分析

Azure文本分析是微軟Azure云服務中的一項功能,提供了強大的文本分析和生成能力。用戶可以通過Azure文本分析API實現情感分析、關鍵詞提取以及文本生成等功能,為開發者提供了豐富的自然語言處理工具。

AI文本生成的技巧

除了了解方法和工具,熟練掌握一些AI文本生成的技巧也是提高生成文本質量的關鍵。以下是一些實用的技巧:

數據預處理

在輸入文本之前,進行良好的數據預處理是確保生成文本質量的關鍵步驟。清洗文本、處理特殊字符、統一格式等預處理步驟能夠有效減少模型學習的噪音,提高生成文本的準確性。

超參數調整

針對不同的任務和數據集,模型的超參數需要進行調整以達到最佳效果。通過對學習率、批大小、模型層數等關鍵超參數進行調整,可以優化模型性能,提高文本生成的質量。

對抗訓練

對抗訓練是一種通過引入對抗性樣本來提高模型魯棒性的技術。在文本生成中,通過向輸入引入輕微擾動,可以使模型更好地處理輸入的變化,提高生成文本的多樣性和魯棒性。

多模態融合

在一些場景中,結合多模態信息可以提高文本生成的表現。例如,將文本與圖像、音頻等信息融合,可以生成更加生動、富有表現的文本內容。這種多模態融合的方法能夠為生成文本提供更多的語境和信息,使其更加豐富和有趣。

長文本生成策略

對于需要生成較長文本的任務,采取適當的策略是必不可少的。一種常見的策略是分段生成,即將文本任務拆分為若干小段落,分別生成,最后再進行整合。這樣可以減輕模型對長期依賴關系的困擾,提高生成文本的一致性。

多樣性控制

在某些情境下,我們可能需要生成多樣性的文本,以滿足不同需求。為了實現這一目標,可以通過引入溫度參數進行多樣性控制。較高的溫度值會增加輸出的隨機性,而較低的溫度值則更加趨向于確定性。

AI文本生成技術的不斷演進為我們的創作提供了全新的可能性。通過了解不同的生成方法、工具和技巧,我們能夠更好地應用這一技術,創造出更加豐富、有趣的文本內容。