圖片來源@GPT生成

使用全球40年的天氣數據,用200張GPU卡進行預訓練,2個月左右的時間,訓練出了參數量達億級的盤古氣象大模型。

這是清華大學畢業3年的畢愷峰訓練大模型的故事。

不過,從成本上看,按照正常情況下,一張GPU 7.8元/小時計算,畢愷峰盤古氣象大模型的訓練成本可能超出200萬。這還是氣象領域的垂直大模型,如果訓練的是通用大模型,成本可能要翻百倍。

有數據統計,中國當下10億參數規模的大模型已經超百個。然而行業蜂擁而上的大模型“煉丹”卻面臨著高端GPU一卡難求的無解題。算力成本高企,缺算力、缺資金也成為了擺在行業面前最直觀的問題。

高端GPU,有多缺?

“缺,當然缺,但是我們能有什么辦法。”某大廠高管被問及是否缺算力問題時脫口而出。

這似乎已經成了行業公認的一道無解題,頂峰時期一張英偉達A100的價格已經被炒到了二三十萬人民幣,單臺A100服務器的月租價格也飆到了5萬-7萬/月。但是即便如此,高昂的價格依然可能拿不到芯片,一些算力供應商也遇到過供應商跳票等之前很難遇到的奇葩經歷。

一位云計算行業高管周立軍也談及類似的感受:“算力短缺的情況確實存在。我們有很多客戶都想要高端GPU資源,但能提供的也暫時無法完全滿足廣泛的市場需求。”

某云服務商搭載A100的高性能計算集群售罄界面

事實證明,高端GPU的短缺短期內在全行業都無解。大模型爆發,市場對算力的需求快速增長,但供給量增速遠遠沒有跟上。雖然算力供給長遠來看一定會從賣方市場進入買方市場,但這個時間究竟要多久,也是個未知。

各家都在盤算著自己手里有多少“貨”(英偉達GPU),甚至用這個來判斷市場份額。比如手里如果接近1萬張卡,市場總共是10萬張卡,那份額就是10%。“到年底保有量大概到4萬,如果市場是20萬的,那可能占20%的市場。”知情人士舉例表示。

一邊是買不到卡,一邊是大模型訓練門檻并沒有業界烘托的那么容易“入門”。上述提到,畢愷峰盤古氣象大模型的訓練成本可能超出200萬。但需要注意的是,畢愷峰盤古氣象大模型是在盤古通用大模型的基礎上訓練出得垂直大模型,它的參數為億級。如果要訓練一款十億規模參數或者更大規模的通用大模型,那么成本可能要十倍、百倍往上加。

“目前投資規模最大的是在訓練,沒有幾十億的資本投入,很難下場去持續做大模型。”騰訊集團副總裁、云與智慧產業事業群COO、騰訊云總裁邱躍鵬透露。

“跑得要快,至少在錢燒完之前能有成果拿到下一輪‘融資’。”一位創業者描述當下大模型“戰況”,“這條路是條絕路。如果你沒有百億千億資金在后邊撐著,很難走得通。”

這一局面下,業內的共同觀點是,隨著大模型市場的角逐廝殺,市場也會從狂熱到理性,企業也會隨著預期的變化來控制成本、調整策略。

無解下的積極應對

沒條件,創造條件也要上——這似乎是大模型參與者中的多數心態。而如何創造條件,應對真實存在的問題,各家也是方法頗多。

由于高端GPU芯片短缺,且中國市場能用的GPU不是最新代次,性能通常更低一些,所以企業需要更長的時間來訓練大模型。這些公司也在尋找一些創新性的辦法來彌補算力短板。

其中一種方法是,使用更高質量的數據去做訓練,從而提升訓練效率。近期,信通院牽頭發布了《行業大模型標準體系及能力架構研究報告》,其中就提到了大模型數據層的評估。報告建議,在數據質量方面,由于其對模型的效果影響會很大,推薦引入人工的標注和確認,至少從原始數據中挑選一定比例進行標注,從而構建并嚴重高質量的數據集。

除了通過高質量數據減少大模型成本,對于業界來說,提升基礎架構能力,實現千卡以上穩定運行兩周不掉卡,是技術難點也是構建可靠基礎架構、優化大模型訓練的方法之一。

“作為云服務商,我們會幫助客戶建立起穩定可靠的基礎架構。因為GPU服務器卡的穩定性會差一些,任何故障都會讓訓練中斷,導致整體的訓練時長增加。高性能計算集群,可以給到客戶更穩定的服務,也能相對減少訓練時長、解決一些算力問題。”周立軍說。

同時,算力卡資源調度也考驗服務商的技術能力。火山引擎華東互聯網解決方案負責人徐巍告訴鈦媒體,擁有算力卡資源只是一方面,如何將卡資源調度起來,真正投入使用,是更具考驗的核心能力、工程能力。“把一個卡拆成很多小卡,盡量能做到分布式的精細化的調度,可以更近一步降低算力成本。”徐巍說道。

網絡也影響大模型訓練速度和效率。大模型訓練動輒千卡,連接幾百臺GPU服務器所要求的網絡速度極高,如果網絡有點擁塞,訓練速度就會很慢,效率很受影響。“只要一臺服務器過熱宕機,整個集群都可能要停下來,訓練任務要重啟。這對云服務運維能力與排查問題能力的要求非常高。”邱躍鵬說。

也有廠商另辟蹊徑,從云計算架構過渡到超算架構也成為減少成本的一種方法,即在都能滿足用戶需求的情況、非量計算的任務及并行任務場景下,超算云大概是云超算一半左右的價格,然后再通過性能優化資源利用率可以從30%提高到60%。

另外,也有廠商選擇使用國產平臺做大模型的訓練和推理以替代一卡難求的。“我們跟華為聯合發布了訊飛星火一體機,能夠在國產平臺上自己做訓練做推理,這是非常了不起的。我特別高興地告訴大家,華為的GPU能力現在已經跟一樣,任正非高度重視,華為的三位董事到專班工作,現在已經把它做到了能對標的A100。”創始人、董事長劉慶峰曾表示。

上述方法,每一種都是一個相對大的工程,所以,一般企業是很難通過自建的數據中心來滿足,很多算法團隊都選擇最專業的算力廠商來支持。這其中并行存儲也是很大的一種成本,以及技術能力,對應的故障率的保障等等也屬于硬件成本的一部分。當然甚至要考慮,IDC可用區電的成本,軟件、平臺、人員成本等運營成本等等。

千卡級別的GPU集群才會有規模化效應,選擇算力服務商,等于說邊際成本為零。中國工程院院士,中國科學院計算技術研究所研究員孫凝暉也曾在演講中提出,AIGC 帶來 人工智能產業的爆發,而智能技術的規模化應用具有典型長尾問題,即具備強 AI 能力的強勢部門 (網安、九院九所和氣象局等)、科研院校與大中企業只占據算力需求主體的大約 20%,另外 80% 則均為中小微企業,這類主體受限于公司規模與預算,往往難以接入算力資源、或受限于算力的高昂價格,從而難以在AI時代浪潮中獲得發展紅利。因此,要實現智能技術的規模化應用,讓人 工智能產業既“叫好”也“叫座”,需要大量便宜、易用的智能算力,讓中小微企業也能方便、 便宜地使用算力。

而無論是大模型對算力的急切的需求,還是算力在應用過程中需要解決的各種難題,這其中都需要注意的一個新變化是,算力已經在市場需求和技術迭代的過程中,成為了一種新的服務模式。

探索算力服務新模式

我們在搶的大模型算力是什么算力?解答這個問題,需要先從算力服務說起。

從種類來講,算力分為通用算力、智能算力和超算算力,而這些算力成為一種服務,是市場與技術雙重驅動的結果。

《2023算力服務白皮書》(以下簡稱“白皮書”)對算力服務的定義是,算力服務以多樣性算力為基礎,以算力網絡為鏈接,以供給有效的算力為目標的算力產業新領域。

算力服務的本質,是通過全新計算技術實現異構算力統一輸出,并與云、大數據、AI等技術交叉融合。算力服務中不僅只有算力,它是算力、存儲、網絡等資源的統一封裝,以服務形式(如API)完成算力交付。

了解這一點就會發現,在搶芯片的,其實是很大一部分是算力服務提供方,即算力生產者。真正在前端調用算力API的行業使用者,只需要提出對應的算力需求。

據鈦媒體App了解,從軟件方角度,所有的軟件交互產生的大模型使用分為三種,第一種大模型API調用,每家都有報價,按價結算;第二個是自有小模型,自己購買算力,甚至是自己部署;第三種,大模型廠商和云廠商合作,也就是專署云,按月支付。“一般就是這三種,當前主要采用API調用,內部小模型自己做了算力調度平臺。”副總裁姚冬對鈦媒體App說。

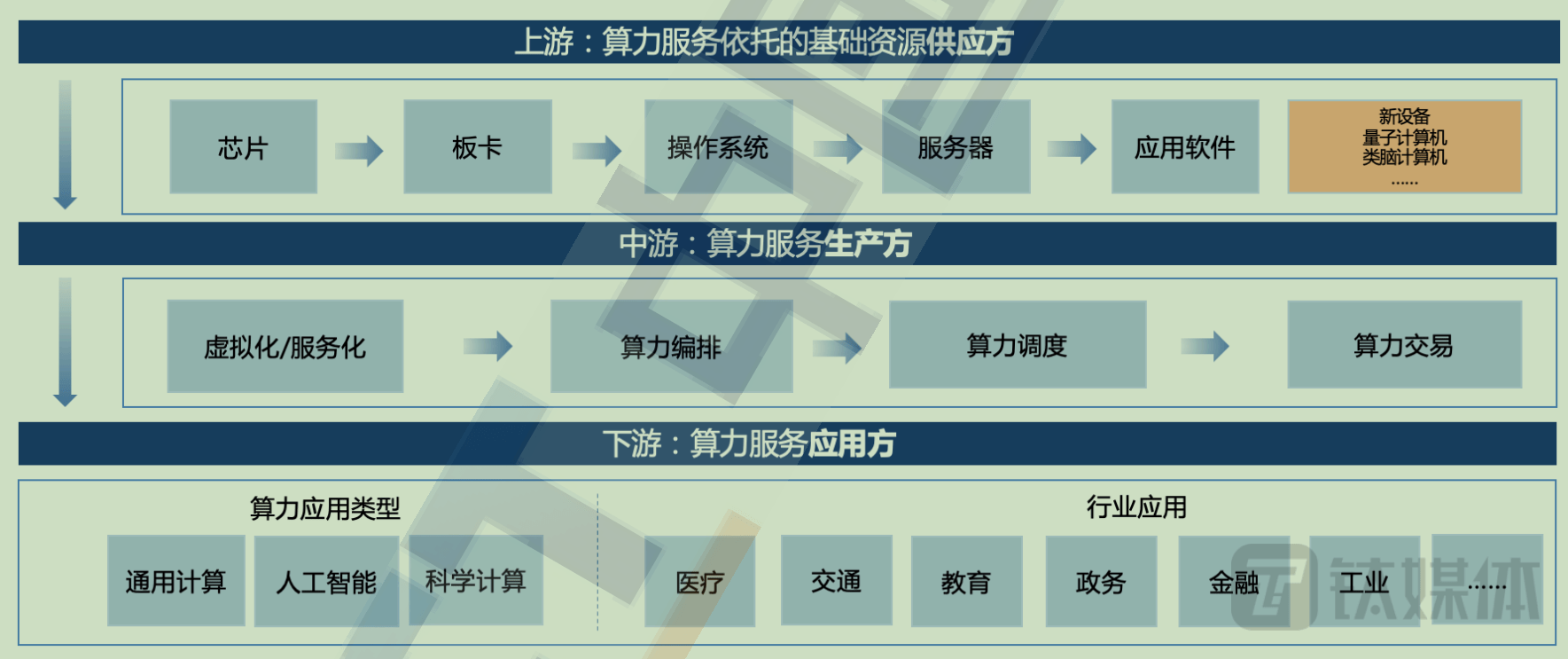

算力產業鏈結構圖,來源:中國信通院

也就是說,在算力結構產業鏈中,上游企業主要完成實現對通用算力、智算算力、超算算力、存儲和網絡等算力服務的支撐資源的供給。例如在大模型算力爭奪戰中,英偉達就屬于上游算力基礎資源供應方向行業供應芯片,而這其中浪潮信息等服務器廠商股票應聲上漲也是受到了市場需求的影響。

中游企業則以云服務商、新型算力服務提供商為主,他們的角色主要通過對算力的編排、算力調度、算力交易技術實現算力生產,并通過API等方式完成算力供給。上述提到的算力服務商、騰訊云、火山引擎都處于這一環節。而算力服務中游企業的服務化能力越強,對應用方的門檻越低,越有助于算力的普惠、泛在化發展。

下游企業,則是依靠算力服務提供的計算能力進行增值服務生成制造的產業鏈角色,如行業用戶等。這部分用戶只需要提出需求,算力生產者則根據需求去配置對應的算力完成用戶下達的“算力任務”。

這相比原來自己購買服務器搭建大模型算力環境,都更有成本和技術優勢。畢愷峰訓練盤古氣象大模型,應該是直接調用了盤古大模型的底層即華為云的高性能計算服務,那么其他大模型企業的使用算力或者說為算力付費的過程會有什么不一樣嗎?

算力商業模式迭代

ChatGLM是最早一批推出的通用大模型,以智譜AI的ChatGLM算力使用為例,據已經公開披露的消息,智譜AI使用了國內多家主流AI算力服務商。“理論上應該所有的都有用了。”知情人士表示,這其中可能還包括了國內主流的算力服務商/云服務商。

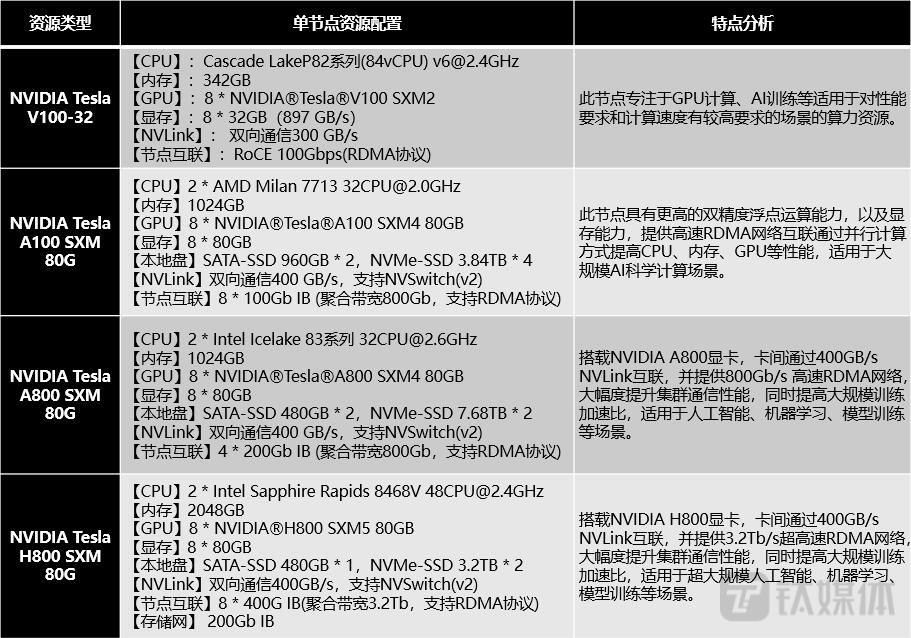

按量計費和包年包月計費是當前算力服務的主流模式,使用需求大致有兩種,一種是選擇對應的算力服務實例,在某云服務商的官網界面,可提供搭載英偉達A800、A100、V100三種主流顯卡的高性能GPU服務器。

某算力服務商提供的高性能計算GPU顯卡類型

另一種是選擇對應的MaaS服務平臺,在MaaS平臺中對大模型進行行業性的精調。以騰訊云TI-ONE平臺按量計費刊例價為例,8C40G V100*1的配置,20.32元/小時,可用于自動學習-視覺、任務式建模、Notebook、可視化建模。

當前行業也在推進算力服務的“算網一體化融合”,通過對計算任務、算網資源狀態等信息的綜合判斷,形成可支持跨架構、跨地域、跨服務商調度的算網編排方案,并完成相關資源部署。例如,只要存一筆錢,存到算力網絡里來,算力網絡中的分區可以隨意調用。根據應用特點,選擇最適合的分區、最快的分區、最具性價比的分區,然后根據時長計費,從預存的資金中把費用扣除。

云服務商也是如此,算力服務作為云服務一項獨特的產品,使他們迅速參與到算力產業鏈中來。

工業和信息化部數據顯示,2022年中國算力總規模達到180EFLOPS,位列全球第二。截至2022年,中國算力產業規模已經達到1.8萬億。大模型算力很大程度上加速了算力產業的發展。

一種說法是,當下的算力服務,實際上是一種新型的“賣電”模式。只不過根據分工的不同,一部分算力服務商可能需要幫助用戶做更多系統性能調試、軟件安裝、大規模作業運行值守和運行特征分析,即一部分的最后一公里運維工作。

隨著大模型高性能計算需求的常態化,脫胎于云服務的算力服務,儼然快速進入大眾視野,形成了獨特的產業鏈和商業模式。只不過在算力產業因大模型而爆發的伊始,高端GPU短缺、算力成本高企、搶“芯”形成了屬于這個時代的獨特風景。

“現階段卷的是供應鏈中誰能拿到卡,英偉達是目前整個行業的王者,所有的市場都被它控制,這是現狀。”知情人士評論。目前境況仿佛是,在供不應求的情況下,誰能拿到卡,誰就可以去交付業務。

但并不是所有人都在搶“卡”,因為短缺是暫時的,問題總會解決。“做長期研究的人其實不搶,正常等著就行了,因為他不會死。現在正兒八經搶卡的只有一批創業公司,他們要保證自己可以活到明年。”上述人士稱。

在諸多不確定性中,算力成為一種服務是確定性趨勢,算力服務商要做的是隨時準備,在大模型回歸理性、市場風向快速轉變的時候,能未雨綢繆。(注:應受訪對象要求,周立軍為化名)

(本文首發鈦媒體APP 作者 |秦聰慧)