如何讓AI語音更富有人類情感?

近日,全球語音領(lǐng)域頂級會議INTERSPEECH 2022公布論文入選名單,出門問問與西工大謝磊教授ASLP實(shí)驗(yàn)室合作撰寫的團(tuán)隊(duì)情感語音合成論文入選,并將在會議上進(jìn)行展示。

INTERSPEECH在國際上享有極高盛譽(yù)并具有廣泛的學(xué)術(shù)影響力,是由國際語音通訊協(xié)會(ISCA)創(chuàng)辦的旗艦級國際會議,也是全球最大的綜合性語音領(lǐng)域的科技盛會,對參會企業(yè)和單位有著嚴(yán)苛的準(zhǔn)入門檻,歷屆INTERSPEECH會議都倍受全球各地語音研究領(lǐng)域人士的廣泛關(guān)注。 此次論文入選,代表出門問問在語音合成領(lǐng)域的科研實(shí)力和技術(shù)創(chuàng)新能力獲得國際學(xué)術(shù)界的認(rèn)可。

論文貢獻(xiàn):跨說話人情感遷移語音合成的實(shí)現(xiàn)路徑

如何讓AI語音更富有人類情感,更有情緒化的表達(dá)?出門問問在題為《端到端語音合成中基于韻律補(bǔ)償?shù)目缯f話人情感遷移》的論文中作以闡述。

跨說話人情感遷移語音合成主要是將情感從具有情感數(shù)據(jù)的源說話人遷移到新的沒有該情感的目標(biāo)說話人上,使目標(biāo)說話人能夠表達(dá)其訓(xùn)練數(shù)據(jù)中不存在的各種情感。“情感遷移”是跨說話人場景中最流行的策略。在這項(xiàng)研究中,從源說話人的情感參考音頻中提取與說話人無關(guān)的情感嵌入至關(guān)重要。否則,情感嵌入中保留的說話人信息就會影響目標(biāo)說話人的音色。然而,在消除源說話人音色信息的過程中,情感嵌入所傳遞的情感信息往往會被削弱,導(dǎo)致合成目標(biāo)說話人的情感語音表現(xiàn)力平淡。

如何防止情感嵌入中的情感信息被削弱是一個(gè)挑戰(zhàn)。具體來說,在合成語音中,具有足夠情感信息的reference embedding 往往會導(dǎo)致源說話人音色泄漏,而進(jìn)一步消除reference embedding中的說話人信息可能會使遷移的情感表達(dá)削弱。為了應(yīng)對這一挑戰(zhàn),出門問問在論文中提出一種韻律補(bǔ)償策略來補(bǔ)償情感嵌入中由于說話人信息消除造成的情感信息損失,以提升合成語音的情感表達(dá)能力。

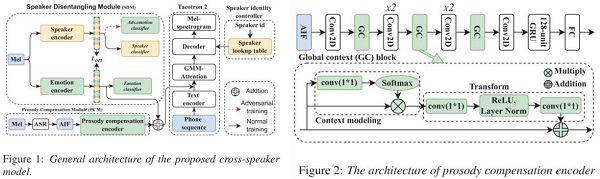

論文中表達(dá),由預(yù)訓(xùn)練的 Automatic Speech Recognition(ASR)模型產(chǎn)生的隱藏表征保留了一定的韻律信息,但沒有明顯的說話人信息,于是我們提出了一個(gè)韻律補(bǔ)償模塊(prosody compensation module, PCM)以參考音頻通過ASR模型得到的中間表征作為輸入用于補(bǔ)償情感信息。本文提出的帶韻律補(bǔ)償?shù)目缯f話人情感語音合成模型,包含說話人解耦模塊(speaker disentangling module, SDM)、說話人嵌入模塊和PCM模塊。其中,SDM是從參考頻譜中獲得說話人無關(guān)的情感嵌入,PCM是從AIF中獲得額外的情感信息,以補(bǔ)償因解藕說話人音色而導(dǎo)致的情感嵌入中的情感信息損失。為了有效地從AIF中提取全局韻律信息,還引入了一種由全局上下文模塊global context(GC) (如Figure 2所示) 輔助的韻律補(bǔ)償編碼器。實(shí)驗(yàn)表明,該方法能夠有效地緩解解耦后的情感嵌入中情感表現(xiàn)力受損的影響,在提升遷移情感表現(xiàn)力的同時(shí)保持目標(biāo)說話人的音色。

語音合成示例:

行業(yè)應(yīng)用:打造業(yè)內(nèi)領(lǐng)先的AI配音神器「魔音工坊」

近年來,出門問問在語音技術(shù)上的積累日漸成熟,并逐漸打磨一款面向消費(fèi)者的AI配音產(chǎn)品——「魔音工坊」。該產(chǎn)品基于出門問問自研語音合成系統(tǒng)MeetVoice,發(fā)音精準(zhǔn),韻律流暢,現(xiàn)已成為深受短視頻創(chuàng)作者們喜愛的頂級配音神器。

魔音工坊擁有豐富的配音編輯功能,在類似word「編輯器」界面,可輕松實(shí)現(xiàn)停頓調(diào)節(jié)、多音字、多發(fā)音人、局部變速等全方位的編輯,另有行業(yè)獨(dú)創(chuàng)的重讀、拖音等調(diào)音功能,讓AI配音進(jìn)一步媲美真人。

但如何應(yīng)用魔音工坊的海量數(shù)據(jù),讓不同風(fēng)格、不同情感的說話人互相結(jié)合,使之擁有更多情感豐富、風(fēng)格多樣的發(fā)音人,如何讓發(fā)音人的情感更生動充沛,是魔音工坊一直追求的極致產(chǎn)品體驗(yàn)。

當(dāng)前語音合成系統(tǒng)對風(fēng)格/情感匹配的高質(zhì)量音庫有較強(qiáng)的依賴性,該項(xiàng)技術(shù)可以通過風(fēng)格/情感遷移,實(shí)現(xiàn)“單人千音”的效果。該項(xiàng)技術(shù)的落地將大大提升風(fēng)格化情感化語音合成系統(tǒng)的構(gòu)建效率,降低系統(tǒng)構(gòu)建的成本。

為了實(shí)現(xiàn)“單人千音”的效果,魔音工坊也研發(fā)實(shí)現(xiàn)了“聲音轉(zhuǎn)換”,即把A的說話風(fēng)格(節(jié)奏和韻律等)遷移到B上。轉(zhuǎn)換后的聲音,會有B的音色,并擁有A的節(jié)奏和韻律等信息。

(魔音工坊產(chǎn)品界面)

「魔音工坊」的“聲音轉(zhuǎn)換”可實(shí)現(xiàn):

1、AI合成效果不佳之處,比如破音、發(fā)音不清晰/不飽滿等,可以使用這個(gè)功能,讓你的AI主播,學(xué)習(xí)其他AI主播的播報(bào)效果,或?qū)W習(xí)你的朗讀效果;

2、某個(gè)地方需要重讀,但是AI卻輕描淡寫,這時(shí)候可以嘗試使用聲音轉(zhuǎn)換功能,實(shí)現(xiàn)「知輕重」的效果;

3、某個(gè)地方想要拖音,但是AI讀的比較短平快,這時(shí)候使用聲音轉(zhuǎn)換,實(shí)現(xiàn)「懂緩急」的效果;

4、某句關(guān)鍵的臺詞,AI合成的效果不夠出色,感覺AI配音的效果不佳(比如視頻的開頭黃金10秒,用戶都希望配音能夠出彩),這時(shí)可以嘗試使用聲音轉(zhuǎn)換,讓你的精彩演繹,賦能給魔音工坊的AI發(fā)音人,讓聲音更生動,富于情緒,更有情感。

此篇論文是我們的一部分探索,期待一下魔音工坊上線更多樣性的發(fā)音人,也讓每一個(gè)人都成為聲音的導(dǎo)演,助力AI配音行業(yè)的蓬勃發(fā)展。

未來,出門問問將繼續(xù)深耕語音、聲學(xué)研發(fā)積累,并逐步落地在更多產(chǎn)品服務(wù)中。以更智能的技術(shù)創(chuàng)造更貼心的語音體驗(yàn),富于情感,按「需」發(fā)音。讓人和機(jī)器的交互更自然,讓AI走進(jìn)更多人的日常生活。

論文:《Cross-speaker Emotion Transfer Based on Prosody Compensation for End-to-End Speech Synthesis》

作者:李濤,王新升,謝啟聰,王智超,江明奇,謝磊