近日,一篇來自微軟與華盛頓大學合作的醫療領域研究論文,不經意間揭示了OpenAi系列人工智能模型的詳細參數配置,引起了業界的廣泛關注。

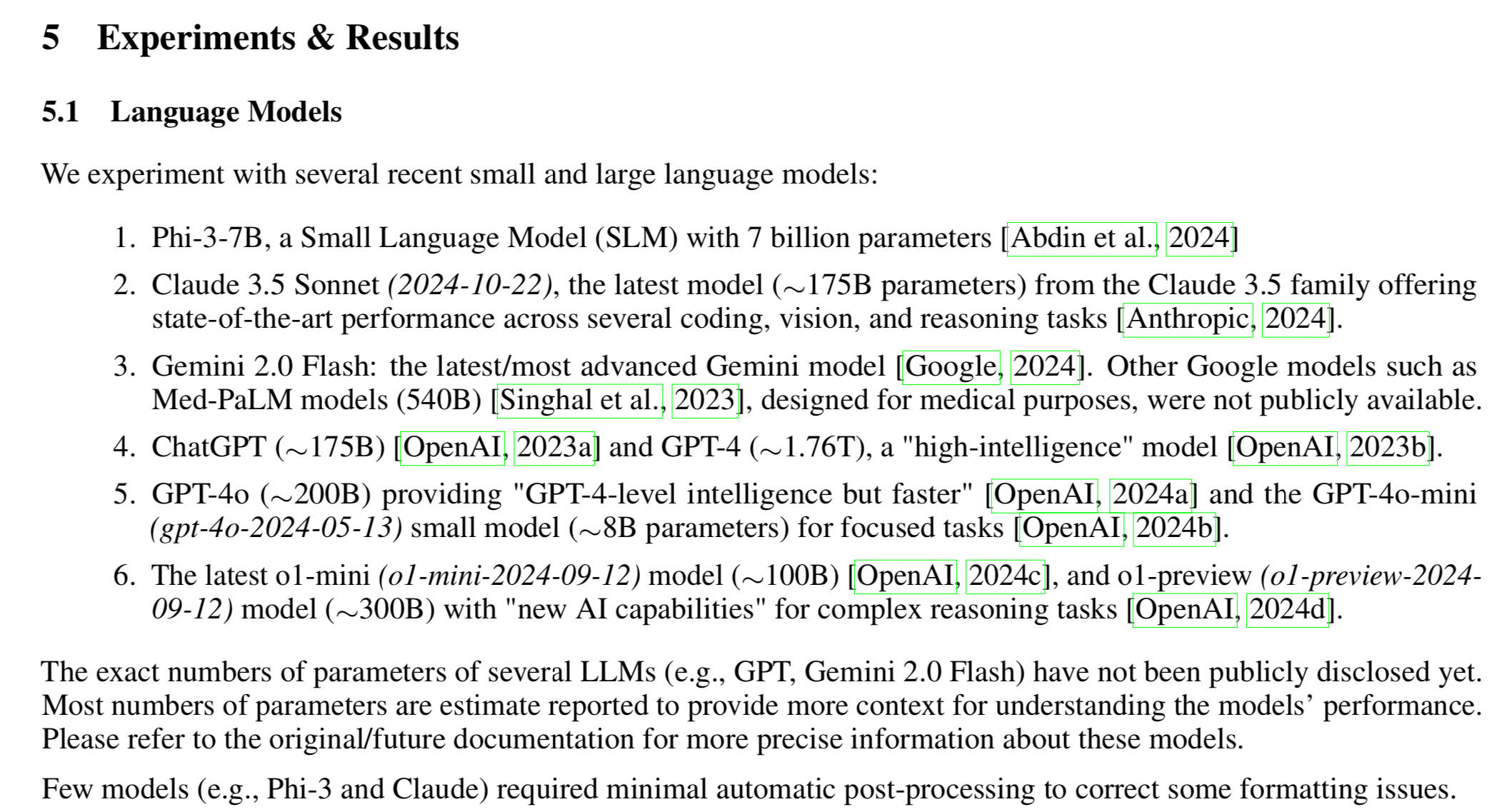

論文中提及,備受期待的GPT-4模型擁有驚人的1.76萬億參數,這一數字彰顯了其在處理復雜語言和理解任務上的強大潛力。而與之相比,GPT-4o系列的參數規模則顯得更為精簡,其基礎版本參數量約為2000億,即便是更為輕量級的mini版,也達到了80億參數,這一設計或意味著OpenAi在追求高效能與資源利用上邁出了新的一步。

論文還披露了其他幾個型號的參數信息:o1-preview版本擁有約3000億參數,而它的mini版本則縮減至約1000億;另一款名為Claude 3.5 Sonnet的模型,其參數量也達到了約1750億的水平。這些信息不僅為研究人員提供了寶貴的參考,也讓公眾對OpenAi的技術進展有了更深入的了解。

值得注意的是,GPT-4o系列參數量的相對減少,尤其是mini版僅有80億參數,這一策略可能旨在滿足更多對計算資源有限制的應用場景需求,同時也展示了OpenAi在模型優化和壓縮技術上的最新成果。這種輕量級模型的開發,有望在保持高性能的同時,降低運行成本,拓寬AI技術的應用范圍。