在2024年的中國數據科技領域,一項重要的成果于CCF中國數據大會上正式亮相。這份名為《生成式大模型安全測評白皮書(2024)》的報告,由中國科學院智能算法安全重點實驗室攜手公安部第三研究所及螞蟻集團的螞蟻安全實驗室共同編制,標志著我國在生成式大模型安全領域的深入研究與積極應對。

白皮書深入剖析了包括GPT、LLaMA、Moss、文心一言等在內的近20個主流生成式大模型的發展現狀,并著重揭示了這些模型在實際應用中面臨的安全風險。通過一系列實踐案例,白皮書不僅指出了當前技術面臨的關鍵挑戰,還提供了有效的應對策略。報告將安全風險分為倫理風險、技術安全風險及內容安全風險三大類,并創造性地提出了指標衡量與模型攻擊兩種安全評估方法,以及倫理性、隱私性、事實性、魯棒性四大安全評估維度,為相關領域的研究者、產業實踐者及政策制定者提供了寶貴的參考。

螞蟻集團自主研發的“支小寶”三重安全保障框架在白皮書中得到了特別介紹,這一框架背后是螞蟻集團的大模型安全一體化解決方案“蟻天鑒”。該解決方案包含兩大核心產品:“蟻鑒”大模型安全檢測平臺和“天鑒”大模型風險防御平臺,分別專注于AI評測與安全防御,確保大模型在生產和應用中的安全、可控與可靠。

自ChatGPT引領的生成式大模型熱潮以來,全球范圍內對這類技術的關注日益升溫。作為人工智能技術的新一輪革命性成果,生成式大模型正深刻改變著全球AI技術的格局,并為我國數字經濟的高質量發展和智能化轉型注入了強勁動力。然而,隨著技術應用的日益廣泛,其潛在的安全風險也逐漸暴露出來,如“大模型幻覺”事件和三星公司機密資料泄露等,這些事件凸顯了生成式大模型在隱私保護、惡意濫用、技術漏洞及合規性等方面的復雜挑戰。

針對這些風險,國家高度重視,并出臺了一系列政策文件,如《生成式人工智能服務管理暫行辦法》,明確了生成式大模型在安全性、風險防控和合規性方面的基本原則和監管要求,為技術的健康發展提供了有力的政策保障。

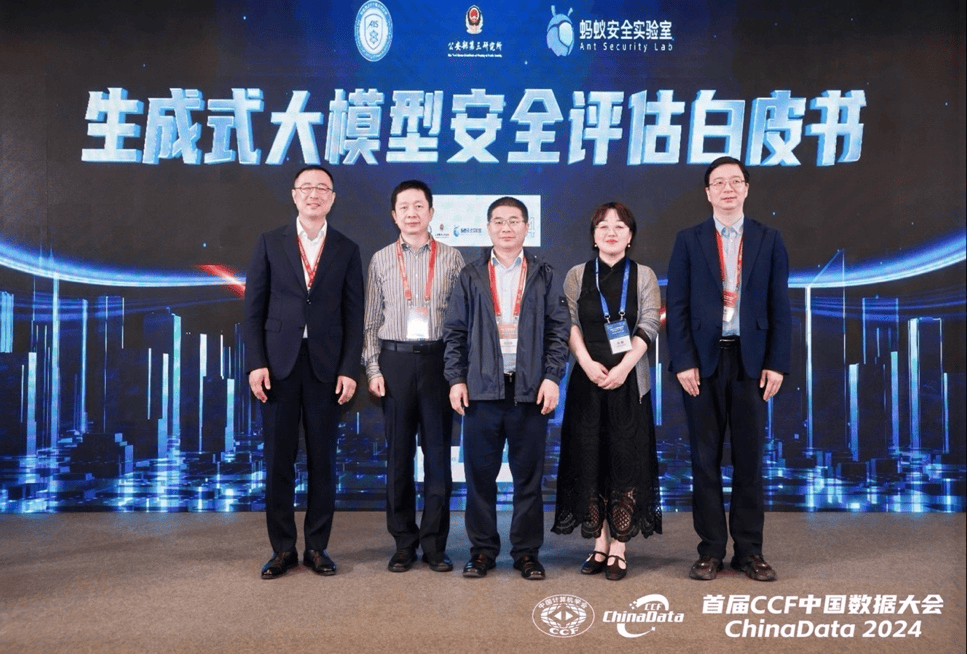

在白皮書的發布儀式上,來自中國科學院智能算法安全重點實驗室、公安部第三研究所、螞蟻安全實驗室及浙江大學計算機學院的專家學者齊聚一堂,共同見證了這一重要時刻。智能算法安全重點實驗室主任、中國科學院計算技術研究所副所長程學旗,公安部第三研究所副所長張巍,螞蟻安全實驗室首席科學家、螞蟻集團大安全機器智能部總經理王維強,以及中國數據大會數據安全高端論壇召集人、浙江大學計算機學院院長任奎,中國科學院計算技術研究所網絡數據科學與技術重點實驗室主任郭嘉豐等重量級嘉賓出席了發布儀式。

王維強在儀式上表示:“我們希望通過這份白皮書,能夠助力生成式大模型的安全性研究與應用推廣,為構建安全、可靠、可控的人工智能生態體系提供堅實支撐,推動技術向著服務人類社會的方向健康發展。”